基于图像描述生成的盲人辅助方案

开发者

发表于 2023/05/06

开发者

发表于 2023/05/06

1. 应用场景

根据中国残疾人联合会的数据,中国现存盲人数量已经超过两千万,多数盲人因为无法了解身处环境而封闭自己,只生活在自己熟悉的环境中,相对于常人活动范围和生活质量都比较低。本方案利用深度学习算法,根据周围环境生成描述语音,播放给盲人用户,帮助他们了解周围环境,融入到更加普遍的社会生活中。

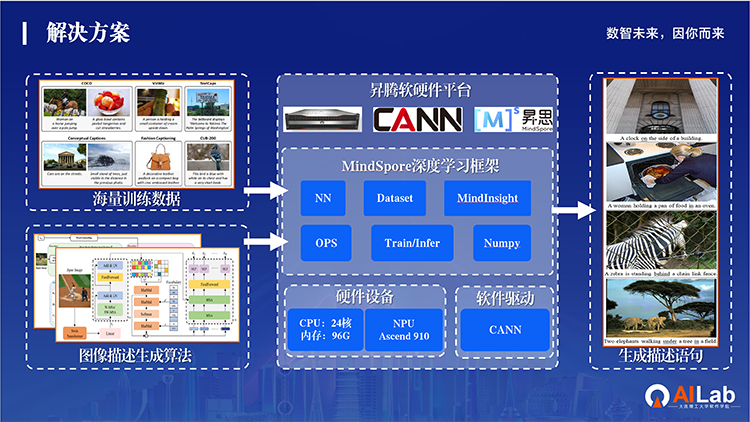

2. 解决方案

解决方案包括两部分,基于HarmonyOS的手机APP,负责收集周围环境图片,播放环境描述语音;基于昇思MindSpore的图像描述生成算法,负责解读图像信息,生成描述语句。APP使用手机摄像头连续的捕获视频,并按照一定频率从视频中抽取单帧图像,发送至后端以生成描述;同时使用HarmonyOS本身所拥有的HiAI智慧能力将描述转换为语音进行播放。后端根据图像生成描述语句,使用基于胶囊网络的图像描述生成算法、基于非自回归的图像描述生成算法,分别提升了描述对图像中位置关系的捕获能力以及描述生成速度。

3. 方案亮点

全栈国产化解决方案

整体解决方案均使用国产软硬件平台实现,前端APP使用HarmonyOS实现,后端人工智能算法使用昇思MindSpore框架实现,算法训练推理所用算力为昇腾硬件Ascend 910,解决方案中涉及到的算法已发表为论文或申请专利,各项均为拥有自主知识产权。

实用化算法创新

针对实际应用场景对算法进行创新。首先环境中物体的相对位置信息是盲人群体十分需要的,针对位置信息的获取,本方案采用胶囊网络对视觉特征进行处理,使生成描述包含准确的位置信息。其次,实际应用过程中系统的延迟十分关键,较大延迟使信息滞后不利于盲人的使用,针对推理速度问题,本方案采用非自回归方法,在提升描述质量的同时,将推理速度提升37倍。

有温度的人工智能

信息无障碍建设一直是国家和社会重点关注的内容,对生理机能上存在缺陷的人们来说,通过辅助手段帮助他们能够同样平等、方便的获取信息,是信息无障碍建设的重要方面。人工智能技术的快速发展为此提供了技术实现路径,帮助盲人在社会生活过程中同样能够感受远方的美景,听见生活的琐碎。

4. 团队介绍

大连理工大学软件学院-AILab团队负责人为刘晗老师。团队主要从事人工智能、深度学习、数据挖掘等相关领域的算法研究工作,致力于把提出的算法应用于自然语言处理、计算机视觉、智能决策、机器人等各个领域。团队主要由三名副教授(于红,刘晗,张晓彤),30多名硕士和博士研究生,多名高年级本科生组成。团队整体队伍年轻化、有活力、科研方向前沿、技术实力强劲,目前主持及参与国家自然科学基金、科技部重大项目青年科学家等国家级科研项目6项,已发表中国计算机学会推荐的CCF A、B类等高水平学术论文40余篇,包括TKDE(CCF A)、KDD(CCF A)、AAAI(CCF A)、IJCAI(CCF A)、SIGIR(CCF A)、WWW(CCF A)、CVPR(CCF A)、ACL(CCF A)等人工智能、机器学习和数据挖掘领域一系列国际顶级期刊和会议。

上一篇

下一篇