基于NPU-Exporter的推理服务器运维监控平台参考实践

发表于 2025/12/17

非商用说明

该文档提供的内容为参考实践,仅供用户参考使用,用户可参考实践文档构建自己的软件,按需进行安全、可靠性加固,但不建议直接将相关Demo或镜像文件集成到商用产品中。

1 方案介绍

1.1 背景

昇腾NPU作为主流算力选择已被广泛应用于深度学习训练与推理场景,NPU的运行状态直接影响业务系统的稳定性和性能表现,对其核心运行指标的实时监控与管理成为运维工作的重中之重。运维系统需要及时了解NPU设备的算力利用率、温度、功耗等关键指标的动态,帮助提前预判硬件故障或性能瓶颈,降低故障定位耗时。同时,企业对监控系统的需求日益多元化,不仅需要实现数据的实时采集与存储,还要求具备灵活的告警配置和可视化展示能力。本参考实践提供一套标准化的昇腾 NPU 监控方案,保障昇腾 NPU 集群的稳定高效运行。

1.2 方案简介

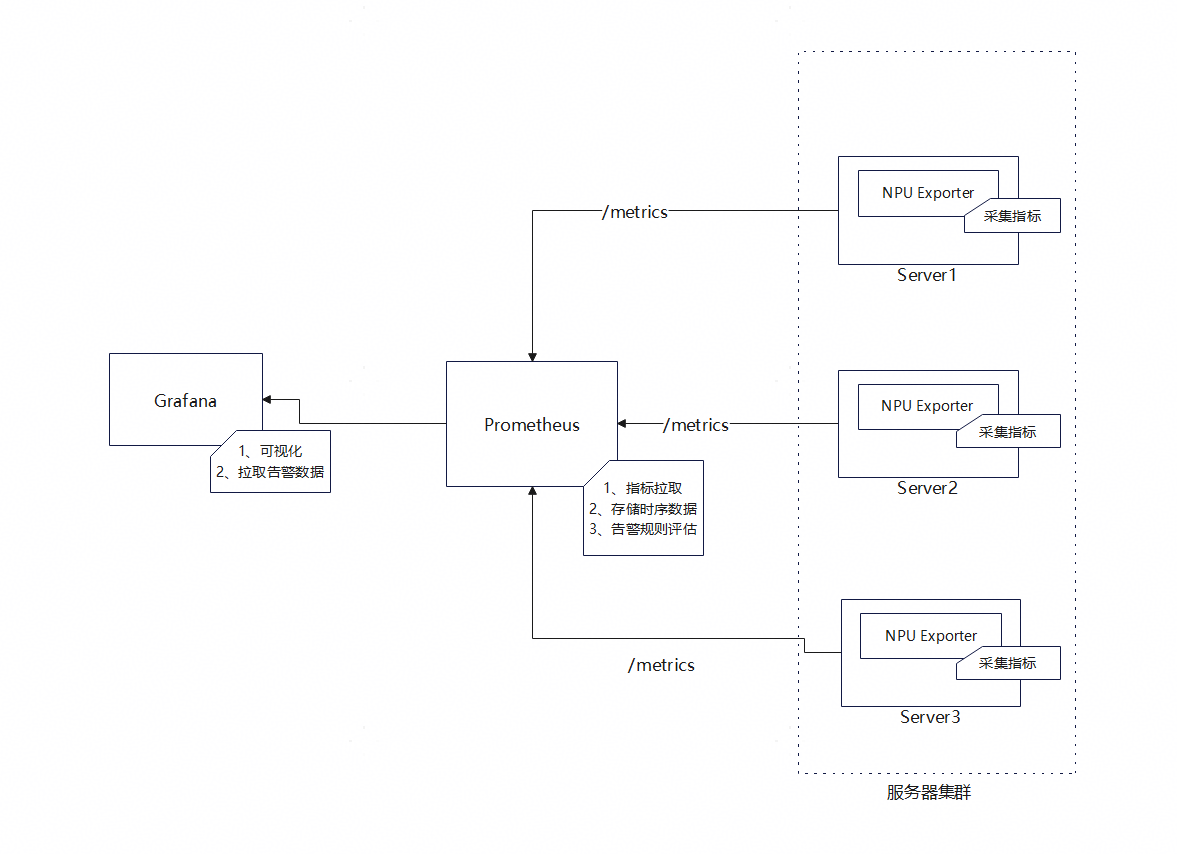

本参考实践采用昇腾 NPU Exporter 组件 + 开源软件 Prometheus(数据汇总和阈值监控)、和 Grafana(可视化)的组合,构建了一套全流程、一体化的昇腾 NPU 监控体系,实现对昇腾 NPU 从指标采集、存储到可视化展示与告警管理的全生命周期监控。

- NPU Exporter :昇腾 NPU指标采集的核心组件,能够以 Prometheus 标准化的格式采集算力利用率、温度、功耗、内存使用率等核心运行指标,并通过 HTTP 接口向外暴露指标数据;

- Prometheus :指标存储与告警规则触发的核心角色,通过定时拉取 NPU Exporter 采集的指标数据,实现监控数据的存储与检索,同时支持自定义监控规则;

- Grafana :可视化展示工具,基于 Prometheus 的指标数据提供图表类型和仪表盘配置能力,将 NPU 的运行指标以直观的可视化形式呈现,在专属告警面板展示集群告警详情(如告警级别、触发时间、指标阈值、恢复状态等),帮助运维人员实时掌握 NPU 的运行状态、分析性能趋势,并快速定位故障问题。

以上各组件关系图如下。

图1 监控平台各组件关系图

1.3 关键特性

- 标准化指标采集:NPU Exporter 遵循 Prometheus 的指标采集规范,针对昇腾 NPU 的硬件架构和运行机制进行深度适配,能够精准、全面地采集算力利用率、温度、功耗、芯片负载、内存带宽等核心运行指标,输出格式符合 Prometheus 的标准数据模型,确保与主流监控体系的兼容性,避免因数据格式不统一导致的集成难题。

- 告警管理:基于 Prometheus 的告警规则引擎,用户可针对昇腾 NPU 自定义告警阈值(如处理器温度持续超温、AI Core利用率持续过高),告警触发后Grafana将告警详细信息渲染到仪表盘;确保运维人员第一时间响应。

- 可视化:Grafana 提供丰富的可视化组件,包括折线图、柱状图、仪表盘等,可根据运维需求灵活配置 NPU 监控仪表盘,直观展示 NPU 的实时运行状态、历史性能趋势和集群整体负载情况。

- 支持硬件类型:本方案支持Atlas系列推理、训练产品。

1.4 应用场景

在基于昇腾 NPU 构建的 AI 训练和推理集群中,该方案可实时监控每台 NPU 设备的算力利用率、功耗、温度等指标,运维人员通过 Grafana 仪表盘掌握集群的整体负载情况,合理分配训练任务和推理请求,避免单台 NPU 过载导致的任务延迟或失败。当集群中某台 NPU 出现温度异常、硬件故障等问题时,告警系统可及时触发通知,帮助运维人员快速定位故障节点并进行替换,保障 AI 业务的连续运行。

1.5 部署方案

1.5.1 典型硬件配置

节点类型 | 服务器配置 | 数量 | 部署内容 |

|---|---|---|---|

NPU Exporter节点 | 集群管理的所有的推理服务器。 可选如下设备: | ≥1(以实际业务需求为准) | 每台推理服务器上部署NPU Exporter。 |

Prometheus、Grafana节点 | 可虚拟化部署,推荐使用容器部署。 1、混合部署场景,选一台推理服务器做管理节点,同时部署NPU Exporter节点与Prometheus节点、Grafana节点。 | 1 | 部署Prometheus以及配置告警规则; 部署Grafana,导入Demo示例界面。 |

1.5.2 软件版本

本参考实践使用的软件配套版本如下(实际使用版本建议不低于表1中的软件版本):

表1

软件/镜像 | 版本 | 说明 |

|---|---|---|

NPU Exporter | 7.1.RC1 | 指标采集的核心组件 |

prom/prometheus | 3.7.3 | 指标存储、告警管理 |

grafana/grafana | 12.3.0 | 可视化展示工具 |

CANN | 8.2.RC2、8.3.RC1 | 昇腾异构计算架构 |

Ascend HDK | 25.0.RC1.1 | NPU驱动固件,要求能配套CANN版本使用,物理机上安装 |

Docker | 18.09.0 | 物理机上安装 |

OS | openEuler release 22.03 (LTS-SP4) | 物理机OS |

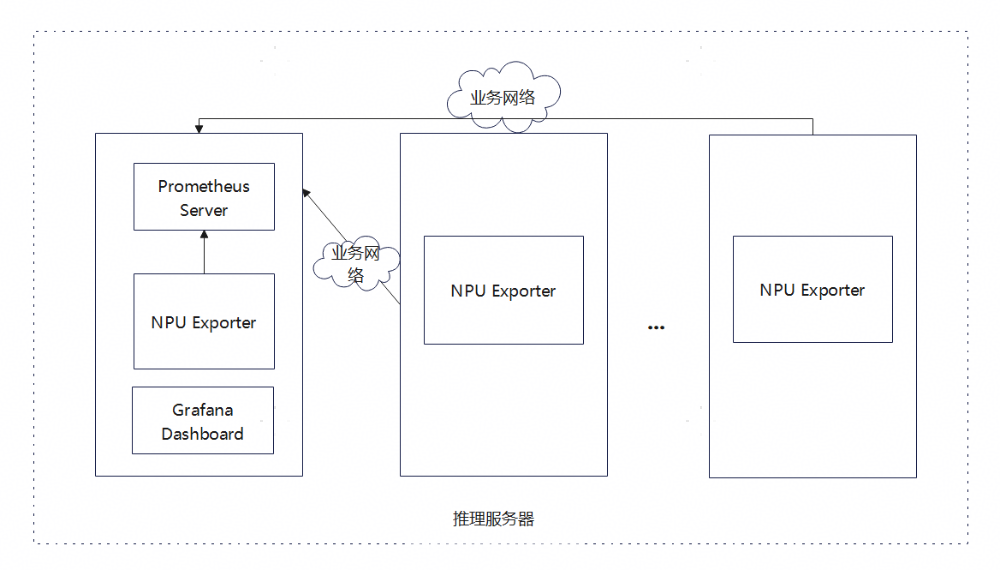

1.5.3 混合部署

当管理小于8台推理服务器时,推荐使用混合部署,即Prometheus和Grafana部署在推理服务器上,如下图所示。

图1 混合部署方案图

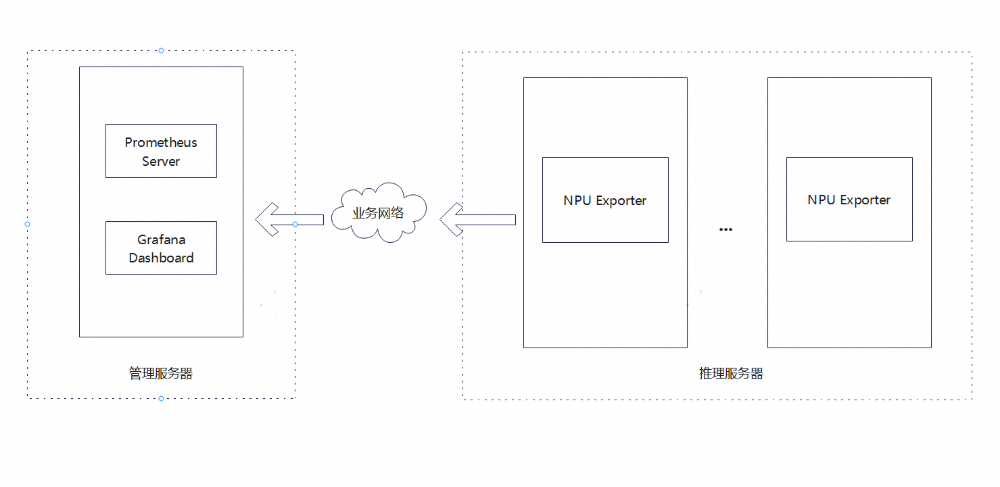

1.5.4 分离部署

当管理8~16台推理服务器时,建议使用分离部署,即使用单独的管理服务器来部署Prometheus和Grafana,如下图所示。

图1 分离部署方案图

2 部署指导

2.1 前置条件

- 已完成OS和Docker安装;

- 参考对应昇腾版本和设备的《昇腾软件安装指南》,推理服务器完成昇腾驱动和固件安装,参考 链接 ;

- 已获取本参考实践的附件。

2.2 安装部署

用户可从以下两种部署方式中选择一种进行安装部署。

2.2.1(可选)手动部署

2.2.1.1 NPU Exporter安装

注意:NPU Exporter需要安装到每台推理服务器上。

1. 下载地址:链接,选择对应版本的软件包下载并上传至服务器:

2. 当前目录下进行解压:

unzip Ascend-mindxdl-npu-exporter_7.1.RC1_linux-aarch64.zip3. 执行以下命令,创建npu-exporter.service文件:

cat > /etc/systemd/system/npu-exporter.service << EOF

[Unit]

Description=Ascend npu exporter

Documentation=hiascend.com

[Service]

ExecStart=/bin/bash -c "/usr/local/bin/npu-exporter -ip=$IP -port=8082 -logFile=/var/log/mindx-dl/npu-exporter/npu-exporter.log>/dev/null 2>&1 &"

Restart=always

RestartSec=2

KillMode=process

Environment="GOGC=50"

Environment="GOMAXPROCS=2"

Environment="GODEBUG=madvdontneed=1"

Type=forking

User=hwMindX

Group=hwMindX

[Install]

WantedBy=multi-user.target

EOF说明:

$IP以当前服务器IP为准

4. 事先准备:

a) 执行以下命令,创建用户

useradd -d /home/hwMindX -u 9000 -m -s /sbin/nologin hwMindX

usermod -a -G HwHiAiUser hwMindXb) 创建组件日志父节点

mkdir -m 755 /var/log/mindx-dl

chown root:root /var/log/mindx-dl若目录已经存在,请确认该目录权限是否正确。

c) 执行以下命令,创建 npu-exporter 日志目录

mkdir -m 755 /var/log/mindx-dl/npu-exporter

chown hwMindX:hwMindX /var/log/mindx-dl/npu-exporter若已经存在该目录,执行以下命令,确保文件夹权限正确

chmod -R 755 /var/log/mindx-dl/npu-exporter

chown -R hwMindX:hwMindX /var/log/mindx-dl/npu-exporter5. 创建npu-exporter.timer文件。通过配置timer延时启动,可保证NPU Exporter启动时NPU卡已就位。

vim /etc/systemd/system/npu-exporter.timer内容参考如下:

[Unit]

Description=Timer for NPU Exporter Service

[Timer]

OnBootSec=60s

Unit=npu-exporter.service

[Install]

WantedBy=timers.target6. 将解压后的二进制包复制到下/usr/local/bin目录下,并修改权限:

cp npu-exporter /usr/local/bin

chmod 500 /usr/local/bin/npu-exporter

chown hwMindX:hwMindX /usr/local/bin/npu-exporter7. 启动NPU Exporter服务

systemctl enable npu-exporter.timer

systemctl start npu-exporter

systemctl start npu-exporter.timer8. (可选)裸机上通过命令行启动NPU Exporter服务:

npu-exporter -ip $ip -port $port -containerd /var/run/docker/containerd/containerd.sock -endpoint /var/run/docker.sock9. 服务启动后,确保可访问网址 http://$ip:$port/metrics (注意关闭防火墙)获取NPU Exporter的输出信息。

2.2.1.2 Prometheus、Grafana安装

1. 从docker拉取Prometheus、Grafana镜像

docker pull prom/prometheus:v3.7.3

docker pull grafana/grafana:12.3.02. 下载所需资源:resource-monitor,进入网页后,点击右上角的“下载当前目录”进行下载。

3. 配置文件清单见下表。

表1 配置文件清单

文件名称 | 文件作用 | 说明 |

|---|---|---|

npu_exporter.yml | Prometheus 的主配置文件,定义采集指标方式;关联告警规则文件 | 根据实际管理机器数量来配置job_name job_name:对应NPU Exporter节点的机型,用来区分不同的机器型号 建议命名规则:机器的IP关键字 + 机器类型(例如host23-800IA2) |

rules.yml | 定义 Prometheus 告警规则(触发条件、级别、描述) | 告警规则对应监控指标清单中出现的推荐告警阈值 |

datasource.yml | 数据源配置 | 注意配置数据源名称为prometheus-data(不建议修改,后续的仪表盘会引用此名称)和Prometheus数据源地址 |

docker-compose.yml | 编排 Prometheus、Grafana 服务;管理容器端口、目录挂载、网络、权限; 定义服务依赖和启动规则 | 容器内的端口配置不要修改,Prometheus默认监听9090端口,Grafana默认监听3000端口号。对外暴露的端口可以修改 |

replace_datasource_uid.sh | 替换全部json代码中数据源UID的脚本 | 注意在脚本首处配置grafana的IP、PORT |

dashboard.yml | 定义仪表盘加载规则 | NA |

Alarm_Details.json | 告警界面 | NA |

NPU_Card_Details.json | NPU卡详情界面 | NA |

NPU_Card_List.json | NPU卡列表界面 | NA |

Overview_Page.json | 概览界面 | NA |

Server_List.json | 服务器列表界面 | NA |

all_monitoring_metrics_NPU.md | 全部监控指标清单 | 包括所有监控指标 |

important_monitoring_metrics_NPU.md | 重要监控指标清单 | 包含推荐使用的监控指标 |

文件夹结构图如下:

resource-monitor

├── docker-compose.yml

├── replace_datasource_uid.sh

├── grafana

│ ├── dashboards

│ │ ├── Alarm_Details.json

│ │ ├── NPU_Card_Details.json

│ │ ├── NPU_Card_List.json

│ │ ├── Overview_Page.json

│ │ └── Server_List.json

│ │

│ ├── data

│ └── provisioning

│ ├── dashboards

│ │ └── dashboard.yml

│ └── datasources

│ └── datasource.yml

├── prometheus

│ ├── data

│ ├── npu_exporter.yml

│ └── rules.yml

│

└── metrics_list

├── all_monitoring_metrics_NPU.md

└── important_monitoring_metrics_NPU.md4. 解压得到 resource-monitor 文件夹,创建好各组件的data文件夹

unzip resource-monitor.zip

cd resource-monitor

mkdir -p grafana/data prometheus/data5. 修改prometheus和grafana相应文件夹权限,获取正确的读写权限

sudo chown -R 65534:65534 ./prometheus/

sudo chown -R 472:472 ./grafana/6. 启动所有容器

docker-compose up -d执行替换脚本replace_datasource_uid.sh,确认脚本回显替换完毕

bash replace_datasource_uid.sh(可选)启动容器时若出现端口冲突,可按照下述方式解决。

1、prometheus端口冲突,例如当前9090端口号出现冲突:

a)修改docker-compose.yml的"9090:9090",改为其他空闲端口号,如9390:"9390:9090"。

b)修改./grafana/provisioning/dashboards/dashboard.yml文件的url: http://xxx.xxx.xxx.xxx:9090 为 9390。

2、grafana端口冲突,例如当前3000端口号出现冲突:

a)修改docker-compose.yml的"3000:3000",改为其他空闲端口号,如3030:"3030:3000"。

b)修改replace_datasource_uid.sh的Grafana_PORT为3030。

(可选)启动容器时若出现名称冲突,可按照下述方式解决。

1、prometheus容器名称冲突:

a)修改docker-compose.yml的prometheus.container_name,改为其他名称。

2、grafana容器名称冲突:

a)修改docker-compose.yml的grafana.container_name,改为其他名称。

(可选)查看所有容器情况

docker-compose ps(可选)修改grafana登录密码(不要直接修改docker-compose.yml文件里的GF_SECURITY_ADMIN_PASSWORD)

docker exec -it grafana-resource-monitor \

grafana-cli admin reset-admin-password 新密码(可选)停止所有容器

docker-compose down7. 通过以下地址访问:

- Prometheus:http://xxx.xxx.xxx.xxx:9090

- Grafana:http://xxx.xxx.xxx.xxx:3000

2.2.2(可选)自动化部署工具

- 参考《 基于Ascend Deployer工具实现第三方软件自动化部署的参考实践 》中 2.1节【获取Ascend Deployer工具】获取自动化部署工具。

- 参考《 基于Ascend Deployer工具实现第三方软件自动化部署的参考实践 》中 2.4.3.4 节【资源监控平台】,使用自动化部署工具完成本监控平台所需软件安装部署。

3 平台使用指导与示例

3.1 功能介绍

3.1.1 概览

该界面主要用于集中展示昇腾服务器集群的整体运行状态与核心资源健康概况,为运维人员提供一站式的集群状态总览入口。具体包括:

- 告警总数:展示当前集群出现的告警总数,运维人员可及时感知到并点击跳转到告警详情页查看;

- 资源总量统计:推理服务器总数、NPU 卡总数、健康卡数、已使用卡数,直观呈现集群的资源规模;

- 硬件健康状态:根据处理器运行状态、网络连通性、处理器核心温度等指标,分别统计各类状态的 NPU 卡数量;

- 算力负载统计:从算力与显存两大核心维度,统计不同负载区间的 NPU 卡数量,为集群资源调度与任务负载均衡提供数据支撑。

通过上述多维度指标的整合展示,运维人员可快速掌握集群的告警情况,整体健康水平、资源使用分布及特殊机型的运行状态,为故障预警、资源优化和运维决策提供全面的数据依据。

图1 概览页示意图

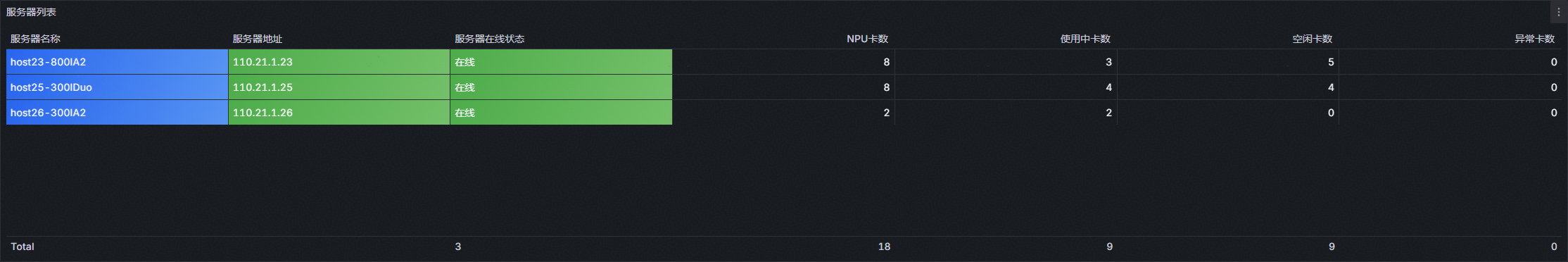

3.1.2 服务器列表

该界面主要用于集中展示昇腾 NPU 服务器集群的节点级精细化信息,为运维人员提供每台服务器的全方位运行详情与资源占用明细,便于快速定位单节点的异常状态与资源瓶颈。界面涵盖的核心信息如下:

- 服务器基础标识信息:清晰列出每台服务器的名称(可在Prometheus配置文件里修改)与服务器地址,作为节点唯一识别依据,方便快速关联物理设备;

- 服务器运行状态监测:明确标注服务器在线状态,通过 “在线 / 离线” 等状态分类,直观呈现节点的运行状态;

- NPU 卡资源维度统计:分别统计每台服务器上 NPU 卡总数、已使用卡数、未使用卡数,清晰反映单节点的算力资源占用比例与闲置情况,为任务调度与资源扩容提供数据支撑;

- 硬件健康状态细分指标:精准统计处理器不健康卡数,定位单服务器内存在处理器故障或性能异常的 NPU 卡,辅助运维人员快速开展故障排查工作。

通过该界面的节点级信息整合,运维人员可实现从集群总览到单节点详情的快速下探,掌握整体资源分布,大幅提升 NPU 集群的运维管理效率。

图1 服务器列表页示意图

3.1.3 NPU卡列表

该界面主要用于展示昇腾 NPU 集群的单卡级监控,展示每张 NPU 卡的硬件信息、运行状态与性能负载详情,为运维人员提供全维度数据支撑,便于精准定位单卡故障、优化算力资源分配。界面核心信息如下:

- 基础身份标识信息:清晰标注每张 NPU 卡的卡号与所属服务器名称,建立 “服务器 - 单卡” 的层级关联关系,方便运维人员快速定位物理设备位置;

- 硬件健康核心状态:实时监测处理器健康状态;同步采集处理器温度、显存温度,预防因过温导致硬件出现降频或损坏;

- 算力与显存性能负载:统计单卡当前运行进程数,反映业务承载情况;实时展示NPU利用率与显存利用率两大核心性能指标,为任务调度与负载均衡提供决策依据。

通过该界面,运维人员可实现从集群总览到单卡详情的精准下探,全面掌握每张 NPU 卡的运行状态,快速识别异常卡的故障类型,提升昇腾 NPU 集群运维管理效率。

图1 NPU卡列表页示意图

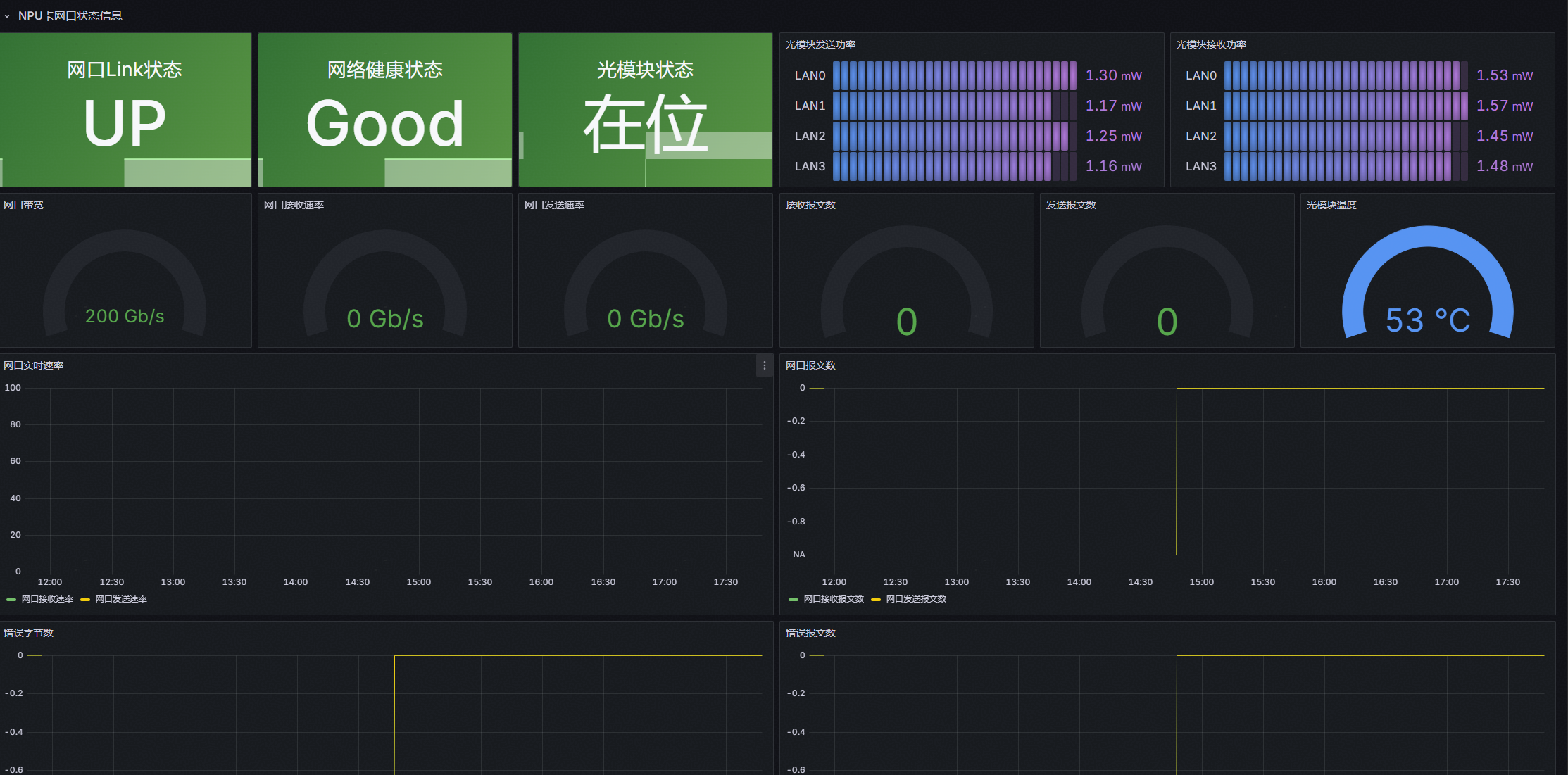

3.1.4 NPU详情

该界面主要用于展示单张 NPU 卡的全维度监控,清晰呈现卡级硬件状态,为运维人员定位单卡故障、分析性能瓶颈提供数据支撑,具体内容如下:

- NPU 卡状态信息区:全面展示当前选中 NPU 卡的核心硬件运行状态与性能负载趋势。

- NPU 卡网口状态信息区(800I A2 机型支持):针对 800I A2 机型的网络硬件特性,定制化展示网口与光模块状态数据。

图1 NPU详情页-1

图2 NPU详情页-2

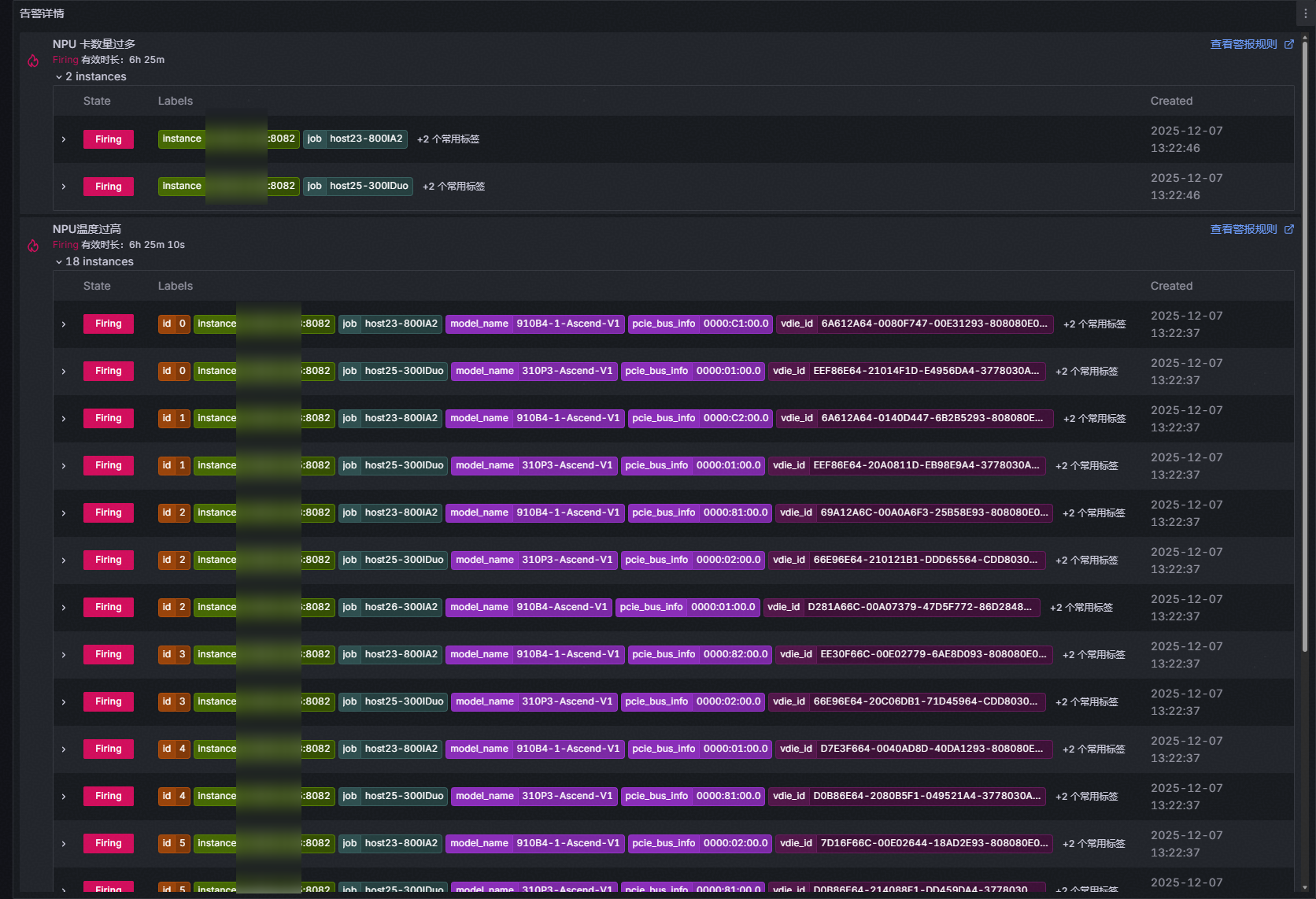

3.1.5 告警详情

该界面主要用于展示集群的所有告警内容,具体内容如下:

3.2 添加指标

参考附录-监控指标清单,用户可以按需添加指标。

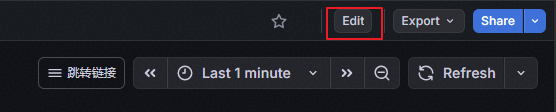

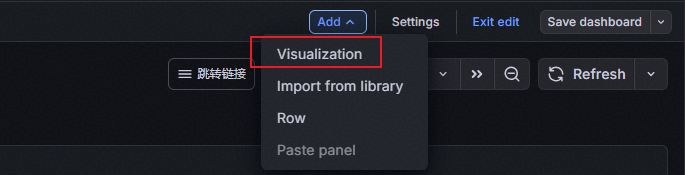

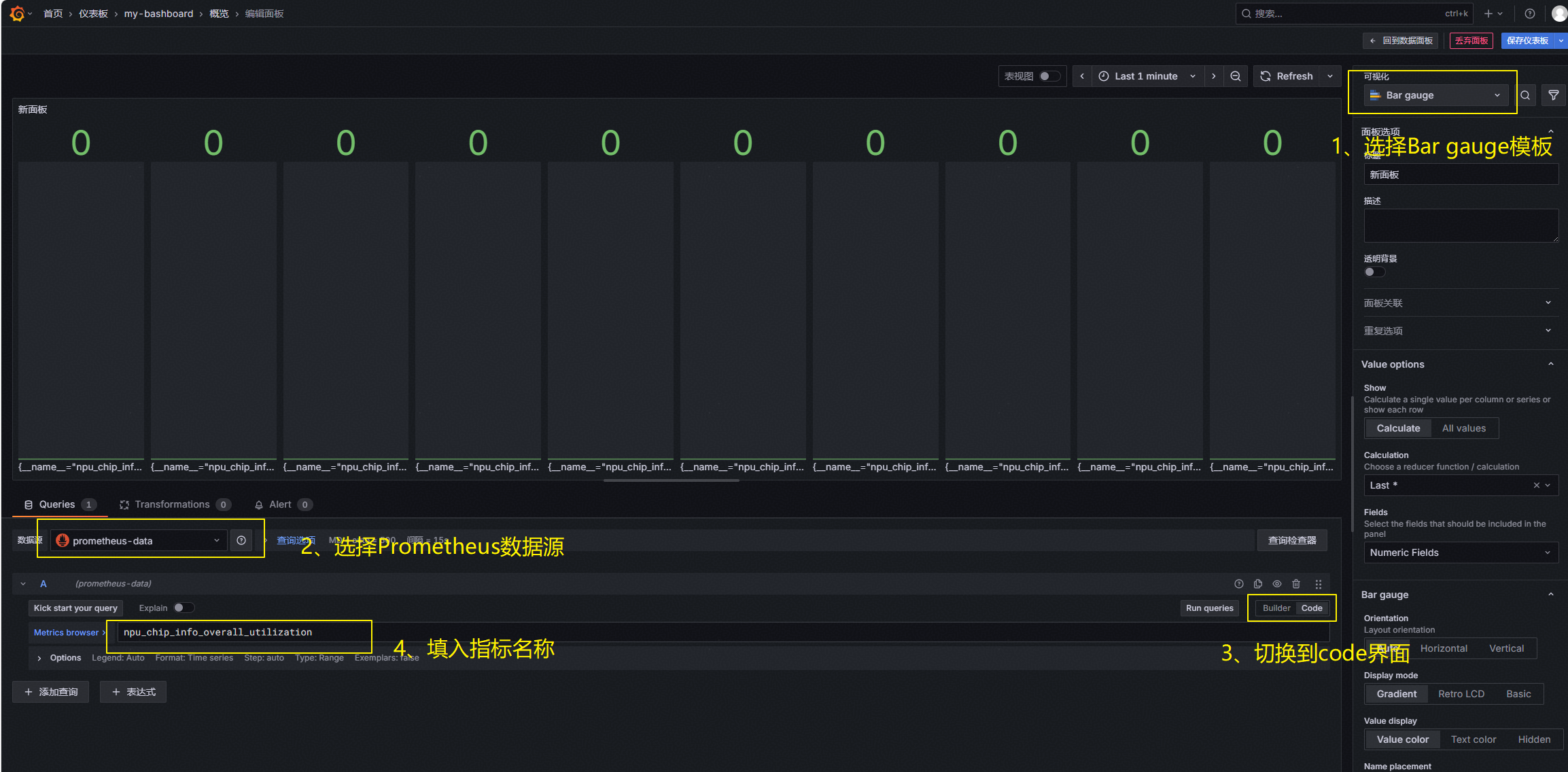

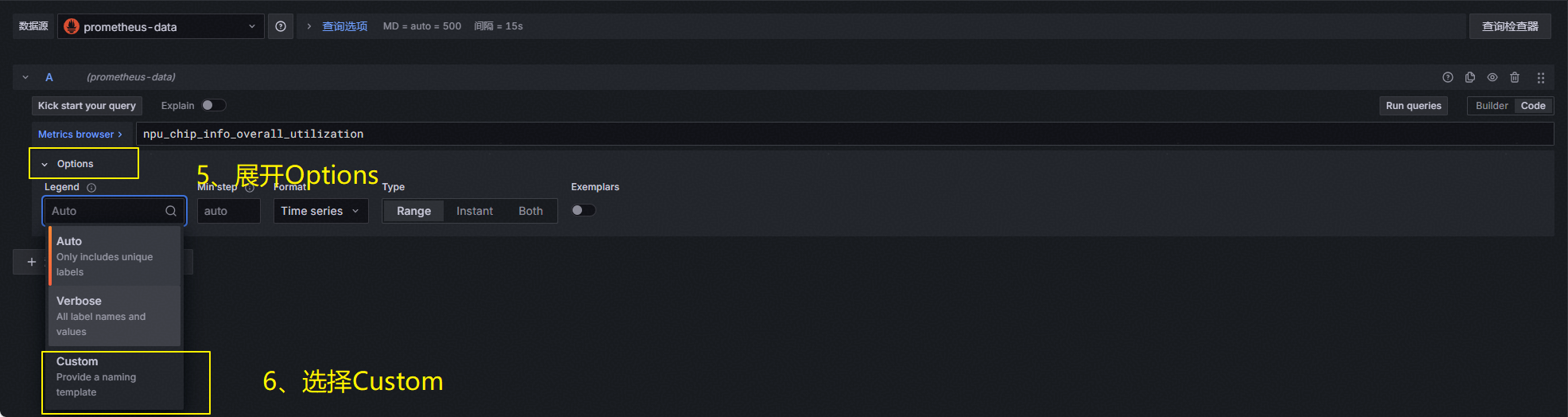

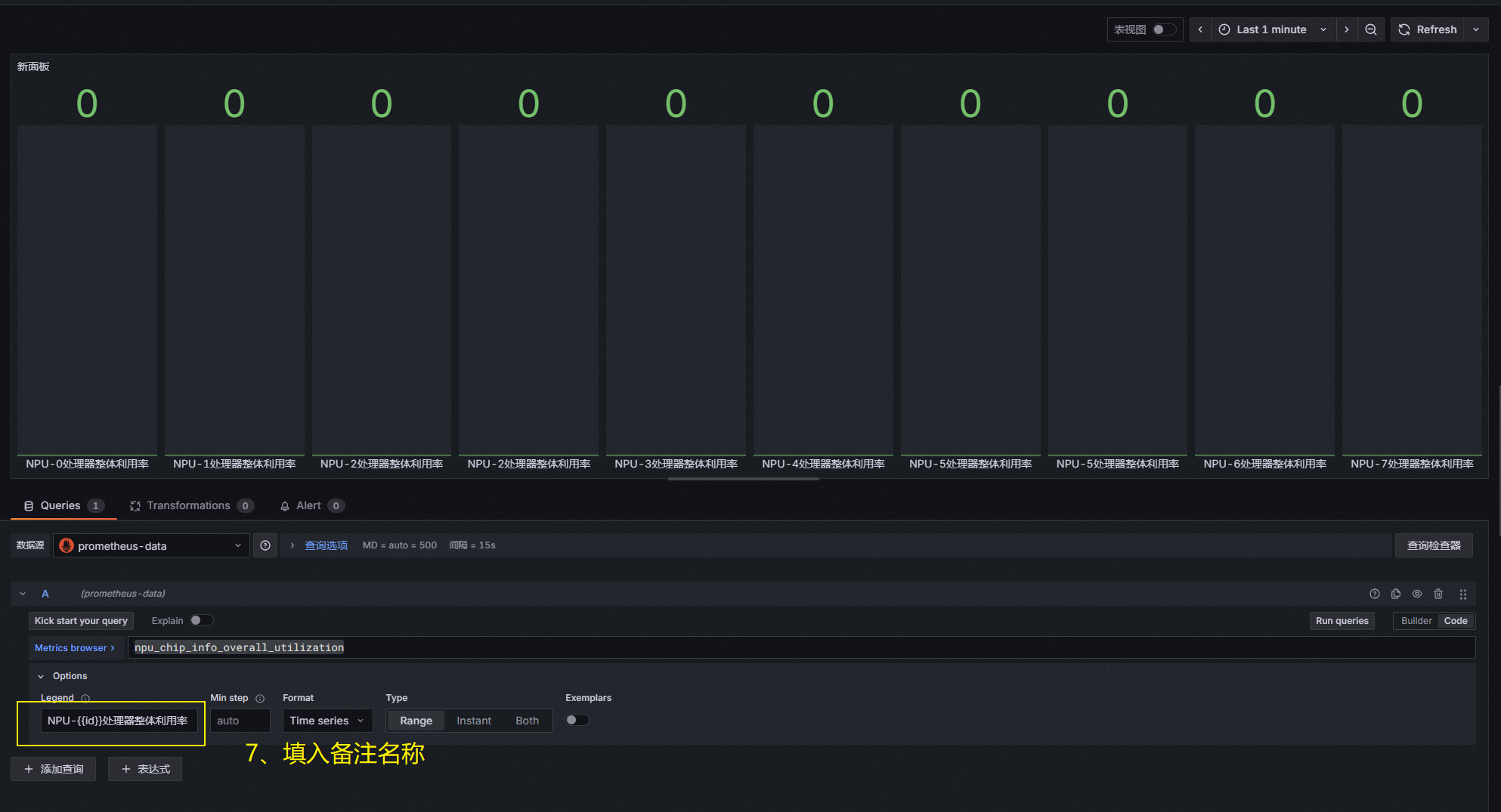

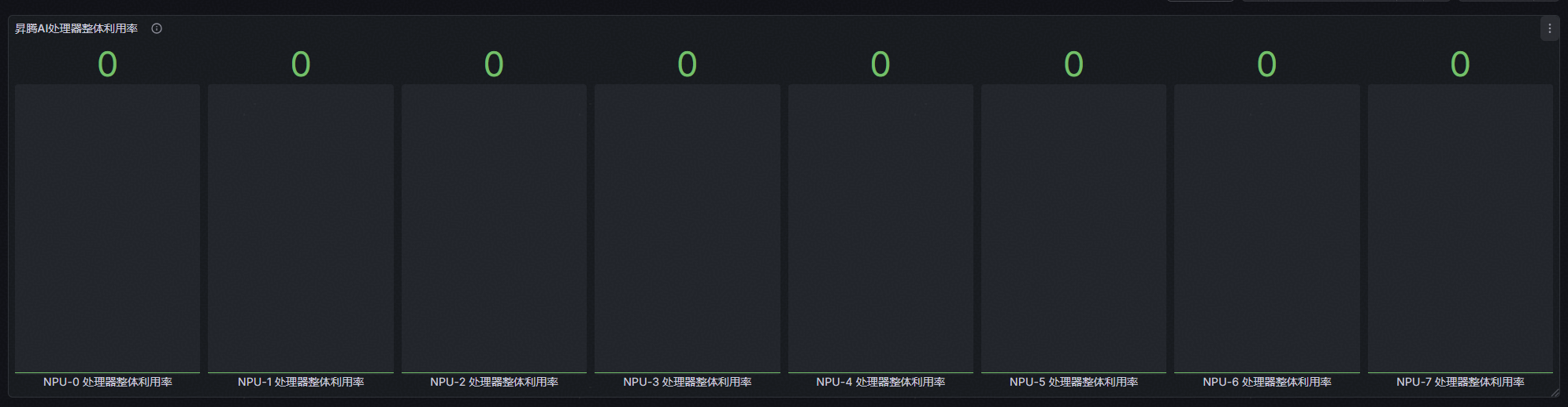

例如:在概览页中添加一个“npu_chip_info_overall_utilization”昇腾AI处理器整体利用率的指标监控

1、点击右上角“Edit”

2、点击“Add” -> “Visualization”

3、编辑页面,具体指标名称从附录-监控指标清单查阅获取。

填入指标备注:NPU-{{id}}处理器整体利用率

4、保存退出,完成监控界面添加

5、用户可参考示例用法来完成更多告警界面自定义开发

3.3 配置告警

通过修改在 2.2.2.2 节【Prometheus、Grafana安装】中的 rules.yml 告警规则配置文件,可以完成新指标告警监控。

例如:需要添加两个告警规则:(1)当NPU利用率持续10分钟超过80%时,发出告警信息;(2)显存利用率持续10分钟超过95%时,发出告警信息。并提示发送告警的NPU详细信息(NPU所属服务器IP,NPU卡序号)。

1、修改rules.yml文件,在末尾添加下面的加粗部分代码

- name: NPU利用率监控

rules:

- alert: NPU利用率过高

expr: npu_chip_info_utilization > 0.8

for: 10m

labels:

severity: warning

annotations:

summary: "NPU 利用率过高( 实例 {{ $labels.instance }} - NPU {{ $labels.id }} )"

description: "利用率 = {{ $value }} ( > 0.8),超过 10 分钟。"

- alert: 显存利用率过高

expr: (npu_chip_info_used_memory / npu_chip_info_total_memory * 100) > 80

OR (npu_chip_info_hbm_used_memory / npu_chip_info_hbm_total_memory * 100) > 80

for: 10m

labels:

severity: warning

annotations:

summary: "显存利用率过高( 实例 {{ $labels.instance }} - NPU {{ $labels.id }} )"

description: "显存利用率 = {{ $value }} (>95%),超过 10 分钟。"2、修改完成后,保存配置文件,重启Prometheus容器使新规则配置生效。

3、用户可参考示例写法来完成更多告警规则自定义开发。

附录-监控指标清单

(这里展示本参考实践推荐指标,全部指标文件见附件【清单】)

用户在监控系统部署、指标配置、告警规则编写的过程中,可按需查阅清单中的指标项,快速完成 Prometheus 采集规则、Grafana 面板可视化的配置工作。清单内容如下图所示:

类别 | 数据信息名称 | 数据信息说明 | 单位 | 支持的产品形态 | 优先级 | 是否告警 | 告警阈值 | 备注 |

Network | npu_chip_link_speed | 网口默认速率 | 单位:MB/s | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

Network | npu_chip_info_bandwidth_rx | 昇腾AI处理器网口实时接收速率 | 单位:MB/s | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

Network | npu_chip_info_bandwidth_tx | 昇腾AI处理器网口实时发送速率 | 单位:MB/s | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

Network | npu_chip_info_link_status | 昇腾AI处理器网口Link状态 | 取值为0或1 1:UP 0:DOWN | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 是 | 由1变0时:告警 由0变1时:取消告警 | 800I A2支持 |

NPU | machine_npu_nums | 昇腾AI处理器数目 | 单位:个 | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 均支持 | ||

NPU | npu_chip_info_network_status | 昇腾AI处理器网络健康状态 | 取值为0或1 1:健康,可以连通 0:不健康,无法连通 | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 是 | 0:告警 1:取消告警 | 800I A2支持 |

NPU | 第一个错误码为:npu_chip_info_error_code 其他错误码:npu_chip_info_error_code_X | 昇腾AI处理器错误码,X表示错误码的索引。 当昇腾AI处理器上没有错误码时,不会上报该字段。 说明: Prometheus场景:若该昇腾AI处理器上同时存在多个错误码,由于Prometheus格式限制,当前只支持上报前十个出现的错误码。X范围:1~9 Telegraf场景:最多支持上报128个错误码。 错误码的详细说明可以通过芯片故障码参考文档获取。 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 是 | 错误码数量为非0时:告警 错误码数量为0时:取消告警 | 均支持 模拟构造个示例出来 |

NPU | npu_chip_info_health_status | 昇腾AI处理器健康状态 | 取值为0或1 1:健康 0:不健康 | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 是 | 0:告警 1:取消告警 | 均支持 |

NPU | npu_chip_info_power | 昇腾AI处理器功耗 | 单位:瓦特(W) | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 说明: 只有Atlas 推理系列产品为板卡功耗,其余产品为昇腾AI处理器功耗。 | 高 | 均支持 | ||

NPU | npu_chip_info_temperature | 昇腾AI处理器温度 | 单位:摄氏度(℃) | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 是 | ≥105℃:告警 <103℃:取消告警 | 均支持 |

NPU | npu_chip_info_process_info | 占用昇腾AI处理器的进程的信息。 Prometheus场景:取值为进程使用的内存。 Telegraf场景:仅当没有进程占用昇腾AI处理器时上报,值为0。 | 单位:MB | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 均支持 | ||

NPU | npu_chip_info_process_info_num | 占用昇腾AI处理器的进程数量。 | 单位:MB | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 均支持 | ||

NPU | npu_chip_info_utilization | 昇腾AI处理器AI Core利用率 | 单位:% | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 均支持 | ||

DDR | npu_chip_info_used_memory | 昇腾AI处理器DDR内存已使用量 | 单位:MB | Atlas 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 | 高 | 300I Duo支持 | ||

DDR | npu_chip_info_total_memory | 昇腾AI处理器DDR内存总量 | 单位:MB | Atlas 训练系列产品 推理服务器(插Atlas 300I 推理卡) Atlas 推理系列产品 | 高 | 300I Duo支持 | ||

片上内存 | npu_chip_info_hbm_used_memory | 昇腾AI处理器片上内存已使用量 | 单位:MB | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

片上内存 | npu_chip_info_hbm_total_memory | 昇腾AI处理器片上总内存 | 单位:MB | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

片上内存 | npu_chip_info_hbm_ecc_single_bit_error_cnt | 昇腾AI处理器片上内存单比特当前错误计数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

片上内存 | npu_chip_info_hbm_ecc_double_bit_error_cnt | 昇腾AI处理器片上内存多比特当前错误计数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

片上内存 | npu_chip_info_hbm_ecc_single_bit_isolated_pages_cnt | 昇腾AI处理器片上内存单比特错误隔离内存页数量 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

片上内存 | npu_chip_info_hbm_ecc_double_bit_isolated_pages_cnt | 昇腾AI处理器片上内存多比特错误隔离内存页数量 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

RoCE | npu_chip_mac_rx_bad_pkt_num | MAC接收的坏包总报文数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_mac_tx_bad_pkt_num | MAC发送的坏包总报文数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_mac_tx_bad_oct_num | MAC发送的坏包总报文字节数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_mac_rx_bad_oct_num | MAC接收的坏包总报文字节数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_roce_rx_all_pkt_num | RoCE接收的总报文数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_roce_tx_all_pkt_num | RoCE发送的总报文数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_roce_rx_err_pkt_num | RoCE接收的坏包总报文数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

RoCE | npu_chip_roce_tx_err_pkt_num | RoCE发送的坏包总报文数 | - | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

光模块 | npu_chip_optical_state | 光模块在位状态 | 取值为0或1 0:不在位 1:在位 | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas 900 A3 SuperPoD 超节点 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 由1变0时:告警 由0变1时:取消告警 | 800I A2支持 | |

光模块 | npu_chip_optical_tx_power_X (X范围为0~3) | 光模块发送功率 | 单位:mW | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas 900 A3 SuperPoD 超节点 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

光模块 | npu_chip_optical_rx_power_X (X范围为0~3) | 光模块接收功率 | 单位:mW | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas 900 A3 SuperPoD 超节点 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 800I A2支持 | ||

光模块 | npu_chip_optical_temp | 光模块温度 | 单位:℃ | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas 900 A3 SuperPoD 超节点 Atlas 800I A2 推理服务器 A200I A2 Box 异构组件 | 高 | 是 | ≥75℃:告警 <73℃:取消告警 | 800I A2支持 |

片上内存 | npu_chip_info_hbm_utilization | 昇腾AI处理器的片上内存利用率。 | 单位:% | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | A2 机型支持 | ||

片上内存 | npu_chip_info_hbm_temperature | 昇腾AI处理器片上内存的温度。 | 单位:°C | Atlas 训练系列产品 Atlas A2 训练系列产品 Atlas A3 训练系列产品 A200I A2 Box 异构组件 Atlas 800I A2 推理服务器 | 高 | 是 | ≥95℃:告警 <93℃:取消告警 | A2 机型支持 |

附件

资源下载地址:resource-monitor