aclnnPromptFlashAttentionV2

Atlas 训练系列产品不支持该算子。

Atlas A2训练系列产品支持该算子。

接口原型

每个算子分为两段式接口,必须先调用“aclnnPromptFlashAttentionV2GetWorkspaceSize”接口获取入参并根据计算流程计算所需workspace大小,再调用“aclnnPromptFlashAttentionV2”接口执行计算。

- aclnnStatus aclnnPromptFlashAttentionV2GetWorkspaceSize(const aclTensor *query, const aclTensor *key, const aclTensor *value, const aclTensor *paddingMask, const aclTensor *attenMask, const aclIntArray *actualSeqLengths, const aclIntArray *actualSeqLengthsKv, const aclTensor *deqScale1, const aclTensor *quantScale1, const aclTensor *deqScale2, const aclTensor *quantScale2, const aclTensor *quantOffset2, int64_t numHeads, double scaleValue, int64_t preTokens, int64_t nextTokens, char *inputLayout, int64_t numKeyValueHeads, int64_t sparseMode, const aclTensor *attentionOut, uint64_t *workspaceSize, aclOpExecutor **executor)

- aclnnStatus aclnnPromptFlashAttentionV2(void *workspace, uint64_t workspaceSize, aclOpExecutor *executor, const aclrtStream stream)

功能描述

- 算子功能:全量推理场景的FlashAttention算子,相较于aclnnPromptFlashAttention接口,此接口新增了支持sparse优化、支持actualSeqLengthsKv优化、支持int8量化功能。

- 计算公式:

self-attention(自注意力)利用输入样本自身的关系构建了一种注意力模型。其原理是假设有一个长度为n的输入样本序列x,x的每个元素都是一个d维向量,可以将每个d维向量看作一个token embedding,将这样一条序列经过3个权重矩阵变换得到3个维度为n*d的矩阵。

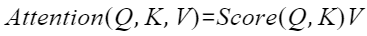

self-attention的计算公式一般定义如下,其中Q、K、V为输入样本的重要属性元素,是输入样本经过空间变换得到,且可以统一到一个特征空间中。公式及算子名称中的"Attention"为"self-attention"的简写。

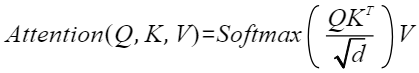

本算子中Score函数采用Softmax函数,self-attention计算公式为:

其中Q和KT的乘积代表输入x的注意力,为避免该值变得过大,通常除以d的开根号进行缩放,并对每行进行softmax归一化,与V相乘后得到一个n*d的矩阵。

aclnnPromptFlashAttentionV2GetWorkspaceSize

- 参数说明:

- query(aclTensor*,计算输入):Device侧的aclTensor,公式中的输入Q,数据类型支持FLOAT16、BFLOAT16、INT8,数据类型与key的数据类型需满足数据类型推导规则,即保持与key、value的数据类型一致。不支持非连续的Tensor,数据格式支持ND。

- key(aclTensor*,计算输入):Device侧的aclTensor,公式中的输入K,数据类型支持FLOAT16、BFLOAT16、INT8,数据类型与query的数据类型需满足数据类型推导规则,即保持与query、value的数据类型一致。不支持非连续的Tensor,数据格式支持ND。

- value(aclTensor*,计算输入):Device侧的aclTensor,公式中的输入V,数据类型支持FLOAT16、BFLOAT16、INT8,数据类型与query的数据类型需满足数据类型推导规则,,即保持与query、key的数据类型一致。不支持非连续的Tensor,数据格式支持ND。

- paddingMask(aclTensor*,计算输入):该参数暂不支持。Device侧的aclTensor,数据类型支持FLOAT16、BOOL,数据类型与query的数据类型需满足数据类型推导规则。不支持非连续的Tensor,数据格式支持ND。如不使用该功能时可传入nullptr。

- attenMask(aclTensor*,计算输入):Device侧的aclTensor,代表下三角全为0上三角全为负无穷的倒三角mask矩阵,不支持非连续的Tensor,数据类型支持BOOL。数据格式支持ND。如不使用该功能时可传入nullptr。限制:其shape支持S,S;B,S,S;1,S,S;B,1,S,S;1,1,S,S;attenMask只支持数据类型BOOL。综合约束请见约束与限制章节。

- actualSeqLengths(aclIntArray*,计算输入):Host侧的aclIntArray,代表不同Batch中query的有效Sequence Length,数据类型支持INT64。如果不指定seqlen可以转入nullptr,表示和query的shape的s长度相同。限制:该入参中每个batch的有效Sequence Length应该不大于query中对应batch的Sequence Length;inputLayout为SH格式时,该入参各Batch的有效Sequence Length之和需要等于query的shape中的S。

- actualSeqLengthsKv(aclIntArray*,计算输入):Host侧的aclIntArray,可传入nullptr,代表不同batch中key/value的有效Sequence Length。数据类型支持:INT64。限制:该入参中每个batch的有效Sequence Length应该不大于key/value中对应batch的Sequence Length。限制:inputLayout为SH格式时,actualSeqLengthsKv参数无效(若传入非空指针,则告警且忽略此参数)。

- deqScale1(aclTensor*,计算输入):Device侧的aclTensor,数据类型支持:UINT64。数据格式支持ND(参考),表示BMM1后面反量化的量化因子,支持pre-tensor(scalar)。 如不使用该功能时可传入nullptr。

- quantScale1(aclTensor*,计算输入):Device侧的aclTensor,数据类型支持:FLOAT。数据格式支持ND(参考),表示BMM2前面量化的量化因子,支持pre-tensor(scalar)。 如不使用该功能时可传入nullptr。

- deqScale2(aclTensor*,计算输入):Device侧的aclTensor,数据类型支持:UINT64。数据格式支持ND(参考),表示BMM2后面量化的量化因子,支持pre-tensor(scalar)。 如不使用该功能时可传入nullptr。

- quantScale2(aclTensor*,计算输入):Device侧的aclTensor,数据类型支持:FLOAT。数据格式支持ND(参考),表示输出量化的量化因子,支持pre-tensor(scalar)。 如不使用该功能时可传入nullptr。

- quantOffset2(aclTensor*,计算输入):Device侧的aclTensor,数据类型支持:FLOAT。数据格式支持ND(参考),表示输出量化的量化偏移,支持pre-tensor(scalar)。 如不使用该功能时可传入nullptr。

- numHeads(int64_t,计算输入):Host侧的int,代表query的head个数,数据类型支持INT64。

- scaleValue(double,计算输入):Host侧的double,公式中d开根号的倒数,代表缩放系数,作为计算流中Muls的scalar值,数据类型支持DOUBLE。数据类型与query的数据类型需满足数据类型推导规则。用户不特意指定时可传入默认值:1.0。

- preTokens(int64_t,计算输入):Host侧的int,用于稀疏计算,表示attention需要和前几个Token计算关联,数据类型支持INT64。用户不特意指定时可传入默认值:214748647,当前不支持负数。

- nextTokens(int64_t,计算输入):Host侧的int,用于稀疏计算,表示attention需要和后几个Token计算关联。数据类型支持INT64。用户不特意指定时可传入默认值:0,当前不支持负数。

- inputLayout(char*,计算输入):Host侧的字符指针CHAR*,用于标识输入query、key、value的数据排布格式,当前支持BSH、BNSD、NSD、SH。用户不特意指定时可传入默认值:"BSH”。限制:inputLayout为SH格式时,不支持S不等长场景(即不支持query与key/value的S不相等)。

query、key、value数据排布格式支持从多种维度解读,其中B(Batch)表示输入样本批量大小、S(Seq-Length)表示输入样本序列长度、H(Head-Size)表示隐藏层的大小、N(Head-Num)表示多头数、D(Head-Dim)表示隐藏层最小的单元尺寸,且满足D=H/N。

- numKeyValueHeads(int64_t,计算输入):Host侧的int,代表key、value中head个数,用于支持GQA(Grouped-Query Attention,分组查询注意力)场景,数据类型支持INT64。用户不特意指定时可传入默认值:0,表示和key/value的head个数相等。限制:在BNSD/NSD场景下,需要与shape中的key/value的N轴shape值相同,且需要满足numHeads整除numKeyValueHeads,否则报错。

- sparseMode(int64_t,计算输入):Host侧的int,表示sparse的模式。数据类型支持:INT64。sparseMode为0时,代表defaultMask模式,如果attenmask未传入则不做mask操作,忽略preTokens和nextTokens(内部赋值为INT_MAX);如果传入,则需要传入完整的attenmask矩阵(S1 * S2),表示preTokens和nextTokens之间的部分需要计算。

- sparseMode为为1时,代表allMask,暂不支持。

- sparseMode为2时,代表leftUpCausal模式的mask,对应以左顶点为划分的下三角场景,需要传入优化后的attenmask矩阵(2048*2048)。

- sparseMode为为3、4、5、6、7、8时,分别代表rightDownCausal、band、prefix、global、dilated、block_local,均暂不支持。用户不特意指定时可传入默认值:0。综合约束请见约束与限制章节。

- attentionOut(aclTensor*,计算输出):Device侧的aclTensor,公式中的输出,数据类型支持FLOAT16、BFLOAT16、INT8。数据格式支持ND。限制:该入参的shape需要与入参query的shape保持一致。

- workspaceSize(uint64_t*,出参):返回用户需要在Device侧申请的workspace大小。

- executor(aclOpExecutor**,出参):返回op执行器,包含了算子计算流程。

- 返回值:

返回aclnnStatus状态码,具体参见aclnn返回码。

第一段接口完成入参校验,若出现以下错误码,则对应原因为:

- 返回161001(ACLNN_ERR_PARAM_NULLPTR):如果传入参数是必选输入、输出或者必选属性,且是空指针,则返回161001。

- 返回161002(ACLNN_ERR_PARAM_INVALID):query、key、value、paddingMask、attenMask、attentionOut的数据类型和数据格式不在支持的范围内。

aclnnPromptFlashAttentionV2

- 参数说明:

- workspace(void*,入参):在Device侧申请的workspace内存起址。

- workspaceSize(uint64_t,入参):在Device侧申请的workspace大小,由aclnnPromptFlashAttentionV2GetWorkspaceSize获取。

- executor(aclOpExecutor*,入参):op执行器,包含了算子计算流程。

- stream(aclrtStream,入参):指定执行任务的AscendCL stream流。

- 返回值:

返回aclnnStatus状态码,具体参见aclnn返回码。

约束与限制

- 参数inputLayout为"B,S,H"时,Q的实际输入维度可以为2或者3。Q的实际输入维度为2时,Q按照"S,H"处理,actualSeqLengths未传入则默认B=1。actualSeqLengthsKv未传入则默认B=1,传入则需要和actualSeqLengths的dim一致。

- 该接口与pytorch配合使用时,需要保证CANN相关包与PyTorch相关包的版本匹配。

- 入参为空的处理:算子内部需要判断参数query是否为空,如果是空则直接返回。参数query不为空Tensor,参数key、value为空tensor(即S2为0),则填充全零的对应shape的输出(填充attention_out)。attention_out为空Tensor时,AscendCLNN框架会处理。其余在上述参数说明中标注了"可传入nullptr"的入参为空指针时,不进行处理。

- 参数sparseMode当前仅支持值为0或2的场景,取其它值时会报错。sparseMode =0时,attenMask如果为空指针,则忽略入参preTokens、nextTokens(内部赋值为INT_MAX)。sparseMode = 2时,attenMask的shape需要为S,S或1,S,S或1,1,S,S,其中S的值需要固定为2048,且需要用户保证传入的attenMask为下三角,不传入attenMask或者传入的shape不正确报错,此场景忽略入参preTokens、nextTokens并按照相关规则赋值。

- D(Head-Dim:表示隐藏层最小的单元尺寸)不以16对齐时,入参query、key、value的数据类型只支持FLOAT16。入参query、key、value的数据类型为INT8时,D必须以32对齐。

- int8量化相关入参数量与输入、输出数据格式的综合限制:

- 输入为INT8,输出为INT8的场景:入参deqScale1、quantScale1、deqScale2、quantScale2、quantOffset2需要同时存在。

- 输入为INT8,输出为FLOAT16的场景:入参deqScale1、quantScale1、deqScale2需要同时存在,若存在入参quantScale2、quantOffset2时(即不为nullptr),则忽略入参quantScale2、quantOffset2。