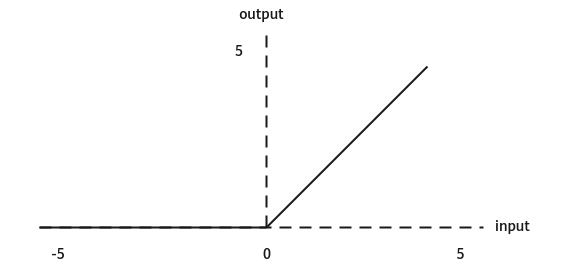

RELU激活类型功能

- 使用参数

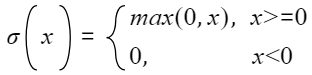

activationType = ACTIVATION_RELU

- 函数图

- 表达式

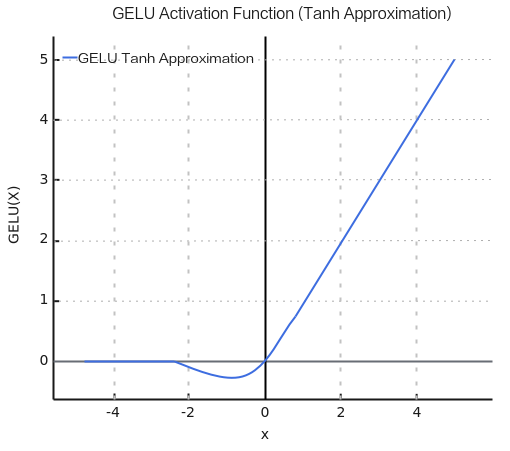

GELU激活类型功能

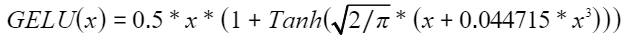

- Tanh近似计算

- 使用参数

- activationType = ACTIVATION_GELU

- geluMode = TANH_MODE

- 函数图

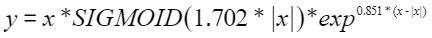

- 表达式

- 使用参数

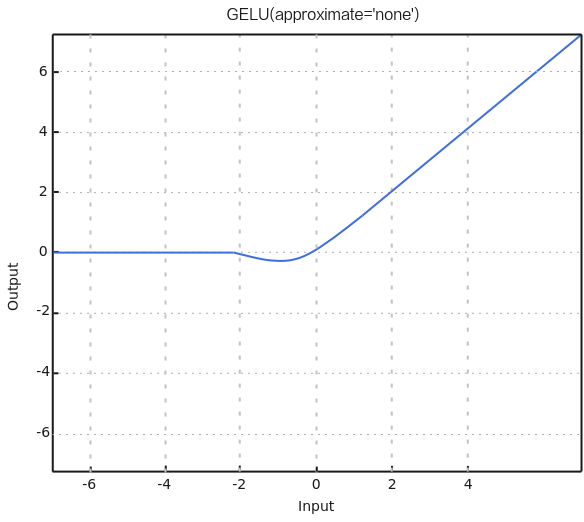

- 非近似计算

- 使用参数

- activationType = ACTIVATION_GELU

- geluMode = NONE_MODE

- 函数图

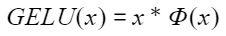

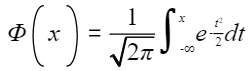

- 表达式

是高斯分布的累积分布函数

是高斯分布的累积分布函数

- 使用参数

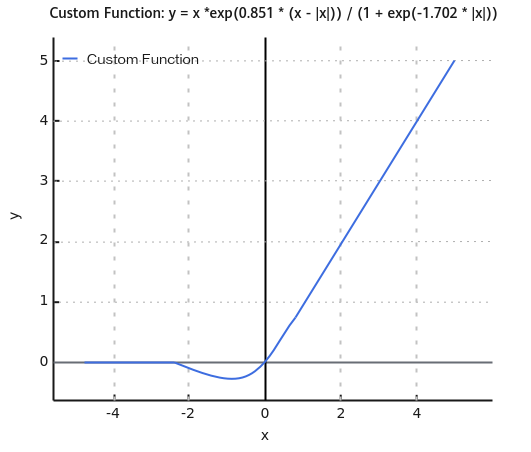

FAST_GELU激活类型功能

- 使用参数

activationType = ACTIVATION_FAST_GELU

- 函数图

- 表达式

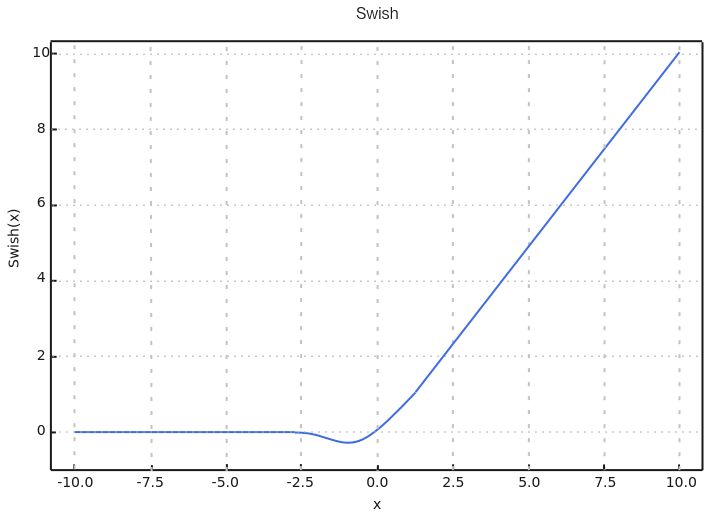

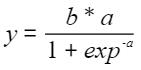

SWISH激活类型功能

- 使用参数

- activationType = ACTIVATION_SWISH

- scale

- 函数图

跟所输入的参数scale有关,当scale=1时

- 表达式

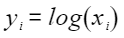

LOG激活类型功能

- 使用参数

activationType = ACTIVATION_LOG

- 表达式

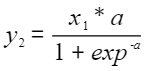

SWIGLU_FORWARD激活类型功能

对于

- 使用参数

- activationType = ACTIVATION_SWIGLU_FORWARD

- dim

- 表达式

a, b为对输入tensor延最后一维进行均分。

- 规格约束

dim只可以延最后一维进行均分,必须传入-1。

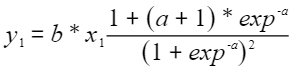

SWIGLU_BACKWARD激活类型功能

当前仅支持

- 使用参数

- activationType = ACTIVATION_SWIGLU_BACKWARD

- dim

- 表达式

x1为输入tensor1

x2为输入tensor2

a,b为对x2延最后一维进行均分

- 规格约束

dim只可以延最后一维进行均分,必须传入-1。

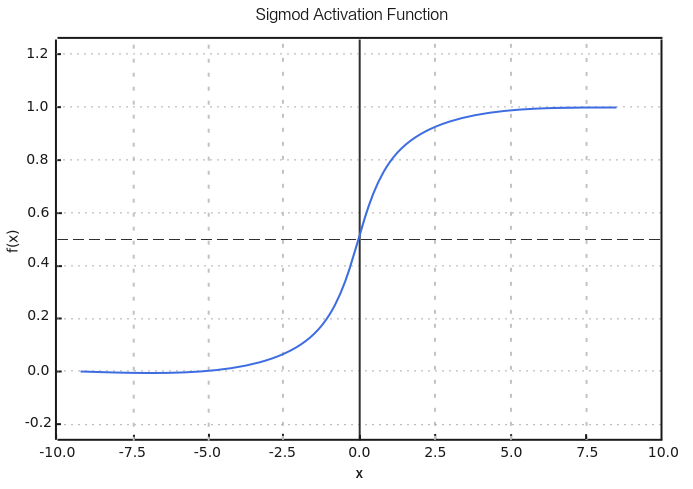

SIDMOD激活类型功能

- 使用参数

activationType = ACTIVATION_SIGMOID

- 函数图

- 表达式

FASTER_GELU_FORWARD激活类型功能

- 使用参数

activationType = ACTIVATION_FASTER_GELU_FORWARD

- 表达式