背景与挑战

当大模型在训练和预测时的输入长度不一致时,模型的泛化能力会下降。若外推能力不佳,大模型在处理长文本或多轮对话时的效果就会受到限制。正弦位置编码的外推能力比较弱,RoPE(Rotary Positional Embedding,旋转式位置嵌入)的外推能力有一定提高但仍然有限。

解决方案

- 支持Alibi位置编码,提高模型外推能力。

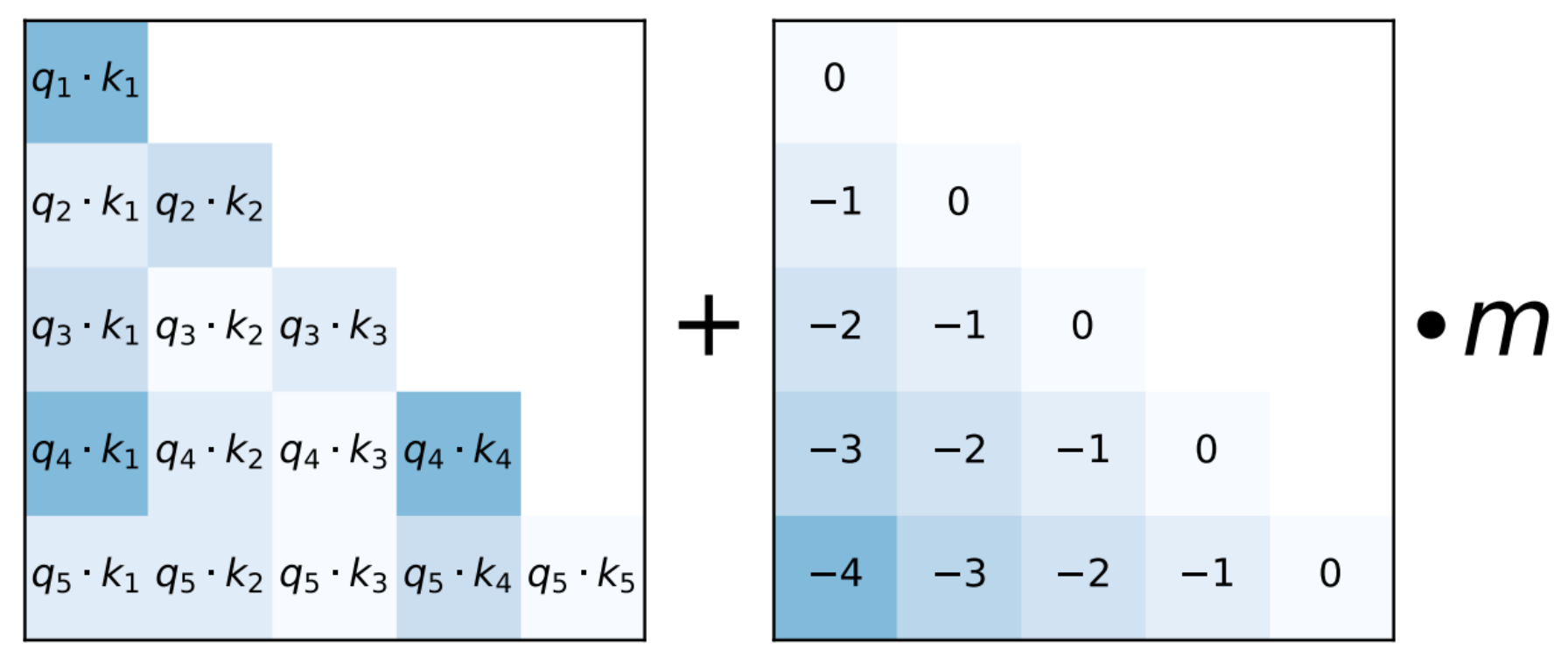

- Alibi算法给attention score添加了一个预设的线性偏置矩阵,如图1所示,使模型能够理解输入之间的相对位置关系。由于位置信息直接作用于attention score上,位置差异性被突出,使模型具有较强的外推能力。

使用场景

当大模型在训练和预测时的输入长度不一致时,使用此方法可获得收益。

使用方法

- 对于不使用融合算子Fusion Attention的情况,设置以下参数即可调用该算法。

--position-embedding-type alibi

- 对于使用融合算子Fusion Attention的情况,设置以下参数:

--alibi-fusion-attn-type 2 # 支持0,2,3

0表示生成alibi后传入,2和3表示核内生成, 3做pse的时候会做sqrt。

如果要设置alibi为对角线对称取反,则需设置alibi_diagonal_opposite,反之(亦是默认情况,且与2和3时核内生成一致)无需进行设置。

使用效果

提高模型外推能力。