AI编程一体机自动化部署指南

发表于: 2026/04/09

本篇为《昇腾OpenClaw一体机自动化部署指南》的姊妹篇。

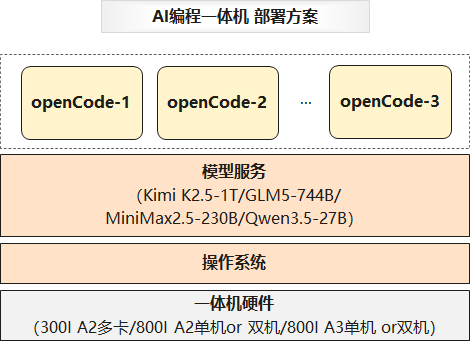

AI编程逐渐成为主流,谷歌2025年DORA报告显示:写新代码、修改已有代码、写文档、创建测试用例等都已成为AI的主战场。我们的AI编程一体机方案,具备如下特点:

· 配置规格多样:支持Atlas 300I A2多卡、Atlas 800I A2单机/双机、Atlas 800I A3单/双机配置规格,满足不同业务负载。

· 模型丰富:支持AI编程最优的开源模型GLM5、MiniMax M2.5、Kimi K2.5、Qwen3.5。

· 低成本:最小支持300I A2双卡部署;w4a8量化,部署成本降低50%。

· 安全:本地化部署开源openCode编程工具和LLM模型,数据不出网。

· 开箱即用:支持一键部署,开箱即用、开箱即优。

采用自动部署工具,进行AI编程一体机的全流程部署仅需4步:

第一步:下载软件包和LLM模型

bash opencode_download.sh --os OpenEuler_22.03LTS-SP4_aarch64 --model Qwen/Qwen3.5-27B执行该命令后会一键下载OpenCode镜像、vLLM-Ascend镜像、NPU驱动与固件、操作系统依赖、docker-compose等软件包及对应的模型权重文件。

第二步:安装基础软件

bash install_base_sw.sh执行该命令后会一键安装操作系统依赖、NPU驱动与固件、docker-compose等软件。

第三步:安装和配置LLM模型服务

bash install_llm.sh --model Qwen3.5-27B --port 8000 --api-key <YOUR_API_KEY>执行该命令后会基于vLLM-Ascend镜像构建容器并启动vLLM大模型服务。

第四步:拉起OpenCode实例

bash install_opencode.sh --port 9080 --url http://0.0.0.0:8000/v1 --model Qwen3.5-27B --api-key <YOUR_API_KEY>执行该命令后会基于OpenCode镜像构建容器并启动OpenCode服务,同时接入第三步启动的大模型服务。

注:以在Atlas 800I A2部署Qwen3.5-27B模型并接入OpenCode为例,具体参数值请以实际为准。

更多使用技巧,请访问:OpenCode 安装部署脚本使用指南

说明:本文档提供的内容为参考实践,仅供用户参考使用,用户可参考文档构建自己的软件,按需进行安全、可靠性加固,但不建议直接将相关Demo或镜像文件直接集成到商用产品中。